القصة: عندما همس النموذج بـ “لا أعرف لماذا”

يا جماعة الخير، أذكر جيداً ذلك اليوم قبل بضع سنوات. كنا نعمل على مشروع ضخم لأحد العملاء في مجال التجارة الإلكترونية. الهدف كان بناء نموذج تعلم آلة يتنبأ بالعملاء الذين على وشك التوقف عن الشراء (ما يعرف بـ Customer Churn). بعد أسابيع من العمل الشاق، وهندسة الميزات، وتدريب عشرات النماذج، توصلنا أخيراً إلى نموذج “بطل” من نوع XGBoost بدقة تجاوزت 92%. كانت الفرحة عارمة في الفريق، وشعرنا أننا أنجزنا المهمة على أكمل وجه.

ذهبنا لعرض النتائج على العميل، وكنا كلنا ثقة. عرضنا الأرقام، الدقة، والمقاييس المبهرة. لكن بعد لحظات من الصمت، سأل مدير التسويق سؤالاً بسيطاً ولكنه كان كفيلاً بنسف احتفالنا: “ممتاز جداً، ولكن… لماذا يقول النموذج أن العميل ‘س’ سيغادر؟ وماذا يمكننا أن نفعل لنمنعه؟”.

في تلك اللحظة، شعرنا وكأننا في ورطة حقيقية. كنا نعرف أن النموذج دقيق، لكننا لم نكن نعرف “كيف” يتخذ قراراته. كان النموذج صندوقاً أسوداً مغلقاً. استطعنا أن نقول له أن هناك علاقة بين عدد مرات الشراء الأخيرة ومتوسط قيمة السلة، لكن لم نتمكن من تحديد السبب الدقيق وراء تصنيف عميل معين بأنه “خطر”. باختصار، “مش فاهمين الطبخة” على مستوى كل عميل. كان هذا الموقف هو الشرارة التي دفعتني للغوص في عالم “الذكاء الاصطناعي القابل للتفسير” (Explainable AI – XAI).

لماذا نحتاج لتفسير قرارات نماذجنا؟ “الصندوق الأسود” ليس صديقاً

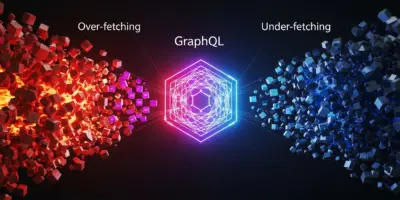

نماذج تعلم الآلة الحديثة، خاصة نماذج الشبكات العصبية العميقة (Deep Learning) أو نماذج التجميع مثل Gradient Boosting، قوية جداً ودقيقة. لكن هذه القوة تأتي على حساب الشفافية. هي أشبه بساحر يؤدي خدعة مذهلة، لكنه يرفض شرح كيف فعلها. هذا الغموض، الذي نسميه “مشكلة الصندوق الأسود” (Black Box Problem)، له عواقب وخيمة:

- فقدان الثقة: كيف يمكن لطبيب أن يثق بتشخيص من نظام ذكاء اصطناعي إذا لم يستطع النظام شرح أسبابه؟ وكيف يثق مدير بنك بقرار رفض قرض دون مبرر واضح؟

- صعوبة التصحيح والتطوير: إذا كان النموذج يرتكب أخطاءً غريبة، فكيف يمكننا تصحيحها إذا لم نعرف من أين تأتي؟

- المسؤولية والقوانين: في العديد من القطاعات، مثل التمويل والصحة، هناك قوانين (مثل GDPR في أوروبا) تمنح المستخدم “الحق في التفسير”. عدم القدرة على تقديم تفسير يعرض الشركات لمساءلة قانونية.

- عدم القدرة على اتخاذ إجراء: كما حدث في قصتي، معرفة “ماذا” سيحدث لا تكفي. نحتاج لمعرفة “لماذا” سيحدث حتى نتمكن من اتخاذ إجراءات فعالة وموجهة.

دخول عالم “الذكاء الاصطناعي القابل للتفسير” (XAI)

من رحم هذه المعاناة، وُلد مجال الذكاء الاصطناعي القابل للتفسير (XAI). الهدف بسيط ومباشر: بناء أدوات وتقنيات تجعل قرارات نماذج تعلم الآلة مفهومة وقابلة للتفسير من قبل البشر. لا تهدف هذه الأدوات إلى استبدال النماذج المعقدة بأخرى بسيطة، بل إلى العمل “فوقها” لتقديم رؤى حول طريقة عملها الداخلية. ومن بين هذه الأدوات، يبرز بطلان رئيسيان هما: LIME و SHAP.

أبطال القصة: أدوات LIME و SHAP

دعونا نتعرف على هاتين الأداتين الرائعتين وكيف ساعدتانا على فتح الصندوق الأسود وفهم ما يدور بداخله.

أداة LIME: المحقق المحلي البسيط

اسم LIME هو اختصار لـ Local Interpretable Model-agnostic Explanations. من اسمها، يمكننا استخلاص ثلاث نقاط قوة:

- Local (محلي): LIME لا يحاول تفسير النموذج بأكمله (فهذا معقد جداً). بدلاً من ذلك، يركز على تفسير قرار واحد محدد (مثلاً: لماذا تم تصنيف هذا العميل بالذات على أنه “خطر”؟).

- Interpretable (قابل للتفسير): يقوم بذلك عن طريق بناء نموذج “وكيل” بسيط جداً (مثل نموذج خطي) حول النقطة التي نريد تفسيرها. هذا النموذج البسيط يكون سهل الفهم.

- Model-agnostic (محايد للنموذج): لا يهتم LIME بنوع النموذج الذي تستخدمه. سواء كان شبكة عصبية، XGBoost، أو أي شيء آخر، يمكن لـ LIME التعامل معه كصندوق أسود وتقديم تفسير له.

تشبيه بسيط: تخيل أن النموذج المعقد هو خبير طعام يتذوق طبقاً معقداً ويقول “هذا لذيذ”. يأتي LIME وكأنه شخص عادي يتذوق لقمة واحدة فقط من هذا الطبق ويقول: “هممم، هذه اللقمة بالذات طعمها حامض وحار بسبب الليمون والفلفل”. إنه يقدم تفسيراً محلياً وبسيطاً.

مثال عملي باستخدام LIME

لنفترض أن لدينا نموذجاً يتنبأ باحتمالية موافقة البنك على طلب قرض بناءً على الدخل، العمر، وقيمة الدين. نريد أن نعرف لماذا رفض النموذج طلب عميل معين.

# نفترض أن لدينا نموذج مدرب اسمه 'model' وبيانات عميل معين 'customer_data'

import lime

import lime.lime_tabular

# 1. إعداد مفسر LIME

# feature_names: أسماء الأعمدة

# class_names: أسماء التصنيفات ('مرفوض', 'مقبول')

# training_data: بيانات التدريب التي استخدمناها لبناء النموذج

explainer = lime.lime_tabular.LimeTabularExplainer(

training_data=X_train.values,

feature_names=X_train.columns,

class_names=['مرفوض', 'مقبول'],

mode='classification'

)

# 2. الحصول على تفسير لبيانات عميل معين

explanation = explainer.explain_instance(

customer_data,

model.predict_proba,

num_features=3

)

# 3. عرض التفسير

# سيُظهر LIME الميزات الثلاثة الأكثر تأثيراً في هذا القرار

# مثلاً: "قيمة الدين > 50000" أثرت سلباً، "الدخل > 7000" أثر إيجاباً

explanation.show_in_notebook(show_table=True)

نصيحة من أبو عمر

استخدم LIME عندما تحتاج إلى إجابة سريعة ومباشرة عن سبب قرار معين. إنه ممتاز لجلسات التصحيح السريعة أو لتقديم تفسيرات فورية للمستخدمين النهائيين داخل تطبيقك. لكن كن حذراً، فتفسيراته قد لا تكون مستقرة دائماً؛ تغيير طفيف في البيانات قد يغير التفسير.

أداة SHAP: المنظور الشامل والعادل

اسم SHAP هو اختصار لـ SHapley Additive exPlanations. هذه الأداة تستند إلى مفهوم “قيم شابلي” من نظرية الألعاب، وهو مفهوم حائز على جائزة نوبل. الفكرة الأساسية هي توزيع “مكافأة” القرار (أي التنبؤ النهائي) بشكل عادل بين كل “اللاعبين” (أي الميزات).

SHAP لا يقدم تفسيرات محلية فقط مثل LIME، بل يجمع بين القوة المحلية والشمولية:

- تفسيرات محلية (Local): يوضح كيف أثرت كل ميزة في قرار معين، دافعةً التنبؤ صعوداً أو هبوطاً.

- تفسيرات شاملة (Global): من خلال تجميع التفسيرات المحلية، يمكن لـ SHAP أن يخبرنا عن أهمية كل ميزة على مستوى النموذج بأكمله.

- الاتساق والموثوقية: بفضل أساسه النظري القوي، تعتبر تفسيرات SHAP أكثر استقراراً وموثوقية من LIME.

تشبيه بسيط: بالعودة إلى مثال فريق كرة القدم، إذا فاز الفريق بنتيجة 3-0، فإن LIME قد يخبرك أن الهدف الأخير كان بسبب تمريرة رائعة من لاعب معين. أما SHAP، فسيقوم بتحليل المباراة بأكملها ليخبرك بمساهمة كل لاعب (بما فيهم حارس المرمى والمدافعون) في تحقيق هذا الفوز الكبير، بالإضافة إلى تحليل كل هدف على حدة. إنه يعطيك الصورة الكاملة.

مثال عملي باستخدام SHAP

باستخدام نفس سيناريو نموذج التنبؤ برحيل العملاء، دعونا نرى كيف يمكن لـ SHAP مساعدتنا.

import shap

# 1. إعداد مفسر SHAP (يوجد أنواع مختلفة، TreeExplainer هو الأسرع لنماذج الأشجار مثل XGBoost)

explainer = shap.TreeExplainer(model)

# 2. حساب قيم SHAP لجميع البيانات أو لجزء منها

shap_values = explainer.shap_values(X_test)

# 3. عرض تفسير شامل (Global Explanation)

# هذا المخطط يوضح أهم الميزات بشكل عام وتأثيرها

shap.summary_plot(shap_values, X_test, plot_type="bar") # يعرض أهم الميزات

shap.summary_plot(shap_values, X_test) # يعرض توزيع تأثير كل ميزة

# 4. عرض تفسير محلي (Local Explanation) لعميل واحد

# هذا المخطط يوضح كيف دفعت الميزات القرار لهذا العميل تحديداً

# مثلاً، العميل رقم 5 في بيانات الاختبار

shap.force_plot(explainer.expected_value, shap_values[5,:], X_test.iloc[5,:])

المخططات التي ينتجها SHAP (مثل الـ `summary_plot` و `force_plot`) قوية جداً بصرياً وتساعد على سرد قصة مقنعة حول سلوك النموذج، سواء للإدارة أو للزملاء في الفريق.

نصيحة من أبو عمر

SHAP هو سلاحك المفضل عندما تحتاج إلى تحليل عميق وموثوق. استخدمه عند إعداد التقارير النهائية للعملاء، وعند محاولة فهم سلوك النموذج بشكل شامل، ولضمان أن نموذجك لا يعتمد على تحيزات غير مرغوب فيها. صحيح أنه قد يكون أبطأ حسابياً من LIME، لكن الرؤى التي يقدمها لا تقدر بثمن. إنه “شغل نظيف” ومحترف.

LIME أم SHAP؟ متى تستخدم كل أداة؟

السؤال ليس “أيهما أفضل؟” بل “ما الأداة المناسبة للمهمة الحالية؟”.

- استخدم LIME:

- للحصول على تفسيرات سريعة وفورية لقرار واحد.

- عندما يكون وقت الحساب عاملاً حاسماً.

- عند التعامل مع بيانات غير جدولية (نصوص أو صور) حيث يكون تطبيقه أسهل أحياناً.

- استخدم SHAP:

- عندما تحتاج إلى فهم شامل لأهمية الميزات في النموذج بأكمله.

- عندما تكون الموثوقية والاتساق في التفسيرات أمراً بالغ الأهمية.

- لتقديم تقارير ورسوم بيانية مقنعة للإدارة وأصحاب المصلحة.

- للحصول على تفسيرات محلية وشاملة من نفس الأداة.

في فريقنا، غالباً ما نستخدم الاثنتين معاً. LIME للفحص السريع أثناء التطوير، وSHAP للتحليل العميق والتوثيق النهائي.

الخلاصة: من الظلام إلى النور 💡

العودة إلى قصتنا مع العميل، بعد أن اكتشفنا أدوات XAI، تغير كل شيء. في المشروع التالي، لم نقدم فقط نموذجاً بدقة عالية، بل قدمنا معه لوحة تحكم تفاعلية تستخدم SHAP لتوضح لكل عميل مصنف كـ “خطر” أهم ثلاثة أسباب وراء هذا التصنيف. مدير التسويق لم يعد يسأل “لماذا؟”، بل أصبح يقول: “ممتاز، الآن أعرف أن هذا العميل يحتاج إلى عرض على تكاليف الشحن، وذاك يحتاج إلى تذكير ببرنامج الولاء”.

لقد انتقلنا من تقديم تنبؤات غامضة إلى تقديم رؤى قابلة للتنفيذ. وهذا هو جوهر الذكاء الاصطناعي الناجح. لم تعد النماذج صناديق سوداء، بل أصبحت شركاء شفافين يساعدوننا على اتخاذ قرارات أفضل.

نصيحتي الأخيرة لك: لا تتوقف عند بناء نموذج دقيق. اسعَ دائماً لفهم “كيف” و”لماذا” يتخذ هذا النموذج قراراته. إن بناء الثقة في أنظمتك لا يقل أهمية عن بناء دقتها. لا تبنِ صناديق سوداء، بل ابنِ جسوراً من الثقة والفهم مع من يستخدمون عملك. ✅